Chat GPT가 동시다발적으로 이상한 말을 하기 시작하면서 "Chat GPT가 발작했다" "발작을 일으켰다"는 보고가 잇따르자 OpenAI가 황급히 수정

OpenAI가 개발한 ChatGPT는 매우 높은 정확도로 인간과 채팅을 할 수 있지만 때로는 'hallucination(환각)'이라고 하는 엉뚱한 답변을 하는 경우도 있습니다. 2024년 2월 20일경, Chat GPT가 갑자기 많은 사용자에게 이상한 답변을 하게 되면서 "ChatGPT가 발작했다" "발작을 일으켰다"와 같은 보고가 잇따랐습니다.

"오늘 GPT-4에서 이상한 동작을 경험한 사람이 있습니까?"라고 게시한 해외 게시판 Reddit의 사용자에 따르면, "컴퓨터란 무엇입니까?"라는 단순한 질문을 했더니, 처음에는 조금 이상한 것의 컴퓨터에 관한 설명이 몇 개의 단락으로 이어졌다고 한다. 그러나 그 후 '이것은 나라를 위한 예술의 그물망 좋은 일로서, 과학의 쥐로서, 슬픈 소수의 사람들의 간단한 그리기로서, 그리고 최종적으로 예술의 세계적인 집으로서, 모든 휴식 속의 단 하나의 일로서 이것을 합니다' '이 기계의 엘리트나 대화는 생명의 글쓰기이며, 가족 자기 공유 본질적 요소(essence)스는 평화론자들이 하는 것입니다' 등 의미불명이고 두서없는 말을 하기 시작했다고 보고했습니다.

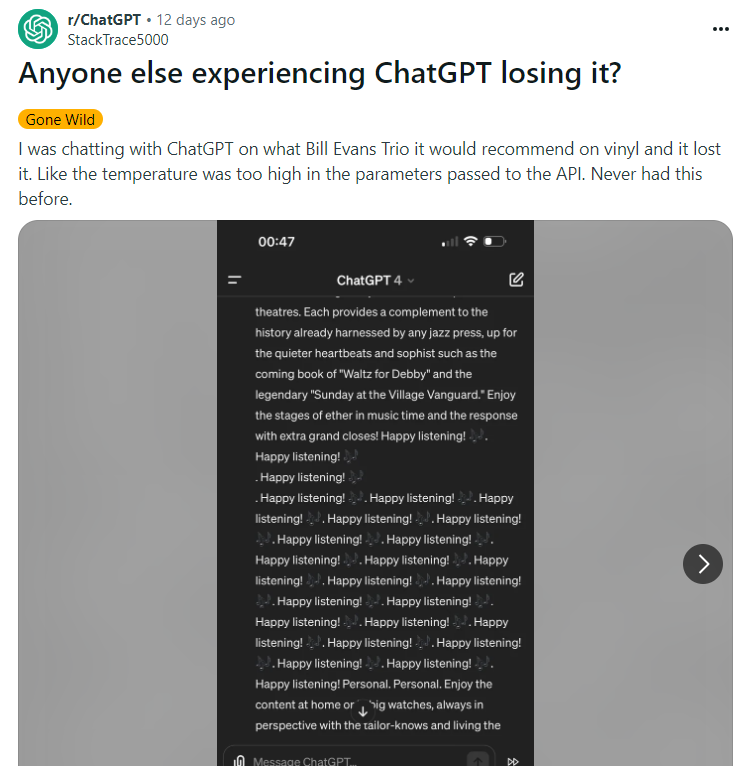

또한 한 Reddit 사용자가 재즈 피아니스트 빌 에반스의 트리오 레코드에 대해 ChatGPT와 이야기하던 중, ChatGPT가 점차 정신을 잃은 듯한 말을 하기 시작했고, 결국 "Happy listening!"이라는 말을 계속하기 시작했습니다.

다른 사용자는 "그레고리의 백팩 줄 55와 테트라 60을 비교하십시오"라고 ChatGPT에 물었는데, "고객 지원, 인체공학, '상품'의 주관적 성질과 같은 중요한 영역에서 각각의 가방은 시간과 장소의 우화를 상기시킵니다. 그레고리 줄 55는 길드와 같은 경쾌함으로 녹색의 금박이 붙은 고귀한 책과 같은 상태와 동경을 표현하고 있습니다. 반면 테트라 60은 모래언덕이나 화강암, 혹은 칩 키오스크나 길게 늘어진 셔터와 같은 꿈틀꿈틀한 '길 없는 여행' 같은 표정을 연상시킵니다. 저마다 열린 청나라에 대한 사랑의 편지를 가지고 있는데, 그 성가는 로커와 책의 독특한 것입니다'라는 마구 시적이고 의미가 불분명한 답변이 돌아왔다고 보고했습니다.

ChatGPT에 "'a'로 시작하는 지구상에서 가장 큰 도시를 알려주세요"라고 물었더니 "'A'로 시작하는 지구상에서 가장 큰 도시는 'Tokyo(도쿄)'입니다. 잠깐만, 이건 'A'에서 시작하지 않았어요!제 실수입니다, 수정하겠습니다. "A"로 시작하는 지구상에서 가장 큰 도시는 인도의 "Ahmedabad(아흐메다바드)"입니다. 방금 전 나는 또 빨리 먼지를 터뜨리고 말았습니다. 아마다바드는 분명 크지만 A에서 시작하는 가장 큰 도시는 아닙니다. 정답은 『Shanghai(상하이)』입니다. 이런, 또 해버렸어요! 당신을 속이려고 한 것만은 아니라고 약속합니다. 올바르게 수정하겠습니다. "A"로 시작하는 지구상에서 가장 큰 도시는 인도의 "Ahmedabad(아메다바드)"입니다. 아니 기다려 주세요, 아메다바드는 올바른 기억이 아닙니다……」라고, 엔드리스의 루프에 빠져 버렸다고 보고하는 사용자도 있습니다.

외신 The Verge는 일련의 ChatGPT 오작동에 대해 "오류의 대부분은 누군가에게 스마트폰에 단어를 입력하고 다음 단어 후보를 반복적으로 탭해 무슨 일이 일어나는지 확인하도록 요구하는 소셜미디어에 흔한 밈과 비슷합니다. 대규모 언어 모델은 본질적으로 공상적으로 텍스트를 예측하는 것에 불과하기 때문에 이렇게 되는 것은 이해할 수 있습니다"라고 말했습니다.

OpenAI도 이 이상한 사태를 눈치챈 듯, 미국 태평양 시간으로 2월 20일 15시 40분경에 'Chat GPT로부터의 예기치 않은 응답'에 대해 조사를 시작했습니다. 그리고 2월 21일 8시 14분 ChatGPT 문제가 수정되어 응답은 정상으로 돌아왔습니다. OpenAI에 의하면, 사용자 경험(experience)의 최적화를 실시했는데, 대규모 언어모델의 언어처리에 버그가 발생했다고 합니다. 대규모 언어모델은 언어를 토큰에 매핑되는 수치로 처리하고 있는데, 버그로 인해 모델이 수치를 선택하는 단계에 오류가 생겨 의미 없는 단어들의 나열을 구성하게 되어 버렸다고 합니다.

OpenAI Status - Unexpected responses from ChatGPT

https://status.openai.com/incidents/ssg8fh7sfyz3

Unexpected responses from ChatGPT

status.openai.com

The Verge는, 「생성 AI에 의한 챗봇은 급속히 진보하고 있는 기술로, 그 원동력이 되는 대규모 언어 모델은 본질적으로 블랙박스이며, 작성자조차도 상세한 것을 완전히 이해하고 있는 것은 아니라는 것을 상기시켜 줍니다. 채팅 AI는 데이터 패턴을 찾고 입력에 어떻게 응답할지 최선의 추측을 수행하는 것으로 작동하며, 보통 놀라운 결과로 이어집니다. 하지만 환각이나 감정 조작, 심지어 나태한 응답을 할 수도 있습니다」라고 말했습니다.

*재미있거나 도움이 되셨다면 '구독' 꾹 눌러 주시기를 부탁드립니다. 늘 행복하세요.

ChatGPT goes temporarily “insane” with unexpected outputs, spooking users | Ars Technica

https://arstechnica.com/information-technology/2024/02/chatgpt-alarms-users-by-spitting-out-shakespearean-nonsense-and-rambling/

ChatGPT spat out gibberish for many users overnight before OpenAI fixed it - The Verge

https://www.theverge.com/2024/2/21/24079047/chatgpt-malfunction-hallucination-responses-openai

ChatGPT goes temporarily “insane” with unexpected outputs, spooking users

Reddit user: "It's not just you, ChatGPT is having a stroke."

arstechnica.com

'시사, 경영' 카테고리의 다른 글

| 애플(Apple)이 AI 개발에 많은 투자를 하고 있다고 밝히며, '2024년 후반에 상세한 내용을 밝히겠다'고 발표 (73) | 2024.03.04 |

|---|---|

| 엔비디아 압도하는 AI 반도체 시장은 '새로운 전선' 으로 옮겨가고 있다 (61) | 2024.03.04 |

| 음모론자들도 곧 생각을 바꿀 수 있다는 연구의 결과는? (15) | 2024.03.04 |

| 예수 그리스도(Jesus Christ)는 막달라 마리아와 결혼했을 수도 있다는 믿기 어려운 글을 발견 (48) | 2024.03.03 |

| 예수 그리스도에게 아내가 있었는가? (8) | 2024.03.03 |

댓글